“Está ahí es discernible. Realmente no está sucediendo… a nivel de volumen o sistémico”, dijo. Clegg dijo que Meta ha visto intentos de interferencia, por ejemplo, en las elecciones taiwanesas, pero que la escala de esa interferencia es de una “cantidad manejable”.

Mientras los votantes acudirán a las urnas este año en más de 50 países, los expertos han dado la alarma sobre la desinformación política generada por la IA y la perspectiva de que actores maliciosos utilicen la IA generativa y las redes sociales para interferir con las elecciones. Meta ya ha enfrentado críticas por sus políticas de moderación de contenido en elecciones pasadas por ejemplo, cuando no logró impedir que los alborotadores del 6 de enero se organizaran en sus plataformas.

Clegg defendió los esfuerzos de la empresa para impedir que se organicen grupos violentos, pero también destacó la dificultad de mantener el ritmo. “Este es un espacio altamente conflictivo. Juegas Whack-a-Mole, con franqueza. Eliminas un grupo, se renombran, se renombran, etc.”, dijo.

Clegg argumentó que, en comparación con 2016, la empresa ahora es “completamente diferente” en lo que respecta a moderar el contenido electoral. Desde entonces, ha eliminado más de 200 “redes de comportamiento no auténtico coordinado”, dijo. La empresa ahora depende de verificadores de datos y tecnología de inteligencia synthetic para identificar grupos no deseados en sus plataformas.

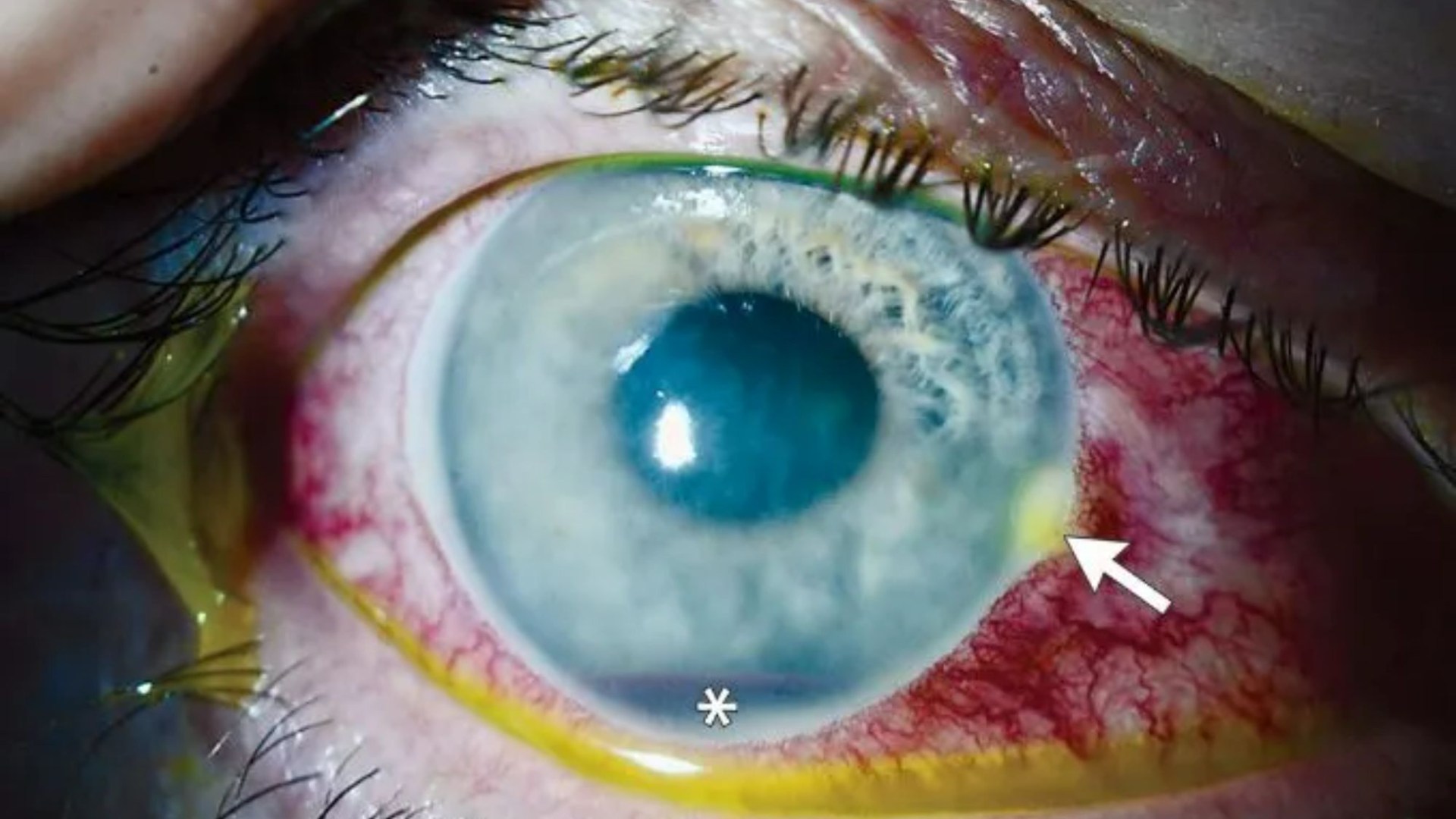

A principios de este año, Meta anunció que etiquetaría imágenes generadas por IA en Fb, Instagram y Threads. Meta ha comenzado a agregar marcadores visibles a dichas imágenes, así como marcas de agua invisibles y metadatos en el archivo de imagen de las imágenes. Las marcas de agua se agregarán a las imágenes creadas utilizando los sistemas de inteligencia artificial generativa de Meta o aquellas que lleven marcadores invisibles estándar de la industria. La compañía dice que sus medidas están en línea con las mejores prácticas establecidas por Partnership on AI, una organización sin fines de lucro de investigación de IA.

Pero al mismo tiempo, Clegg admite que las herramientas para detectar contenido generado por IA aún son imperfectas e inmaduras. Las marcas de agua en los sistemas de IA no se adoptan en toda la industria y son fáciles de alterar. También son difíciles de implementar de manera sólida en texto, audio y movie generados por IA.

En última instancia, eso no debería importar, dijo Clegg, porque los sistemas de Meta deberían poder captar y detectar información errónea y desinformación independientemente de su origen.

“La IA es una espada y un escudo en esto”, dijo.

Clegg también defendió la decisión de la compañía de permitir anuncios que afirmaran que las elecciones estadounidenses de 2020 fueron robadas, señalando que este tipo de afirmaciones son comunes en todo el mundo y diciendo que “no es factible” que Meta vuelva a litigar elecciones pasadas.

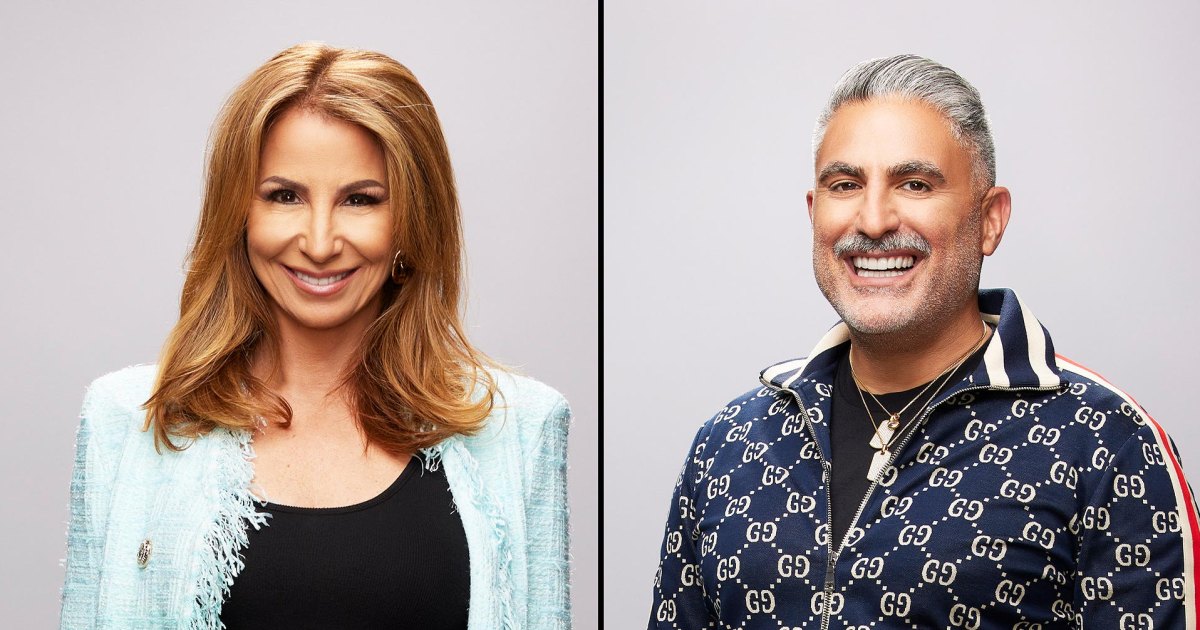

Puedes ver la entrevista completa con Nick Clegg y Revisión de tecnología del MIT La editora ejecutiva Amy Nordrum a continuación.