La industria del periodismo ha estado bajo una inmensa presión económica durante las últimas dos décadas, por lo que tiene sentido que los periodistas hayan comenzado a experimentar con IA generativa para aumentar su productividad.

Una encuesta de Associated Press publicada en abril de 2024 preguntó a periodistas sobre el uso de inteligencia artificial generativa en su trabajo. Casi el 70% de los que respondieron dijeron que habían utilizado estas herramientas para generar texto, ya sea redactando borradores de artículos, redactando titulares o escribiendo publicaciones en redes sociales.

Una encuesta global de mayo de 2024 realizada por la firma de relaciones públicas Cision encontró que la porción era algo menor: el 47% de los periodistas dijeron que habían utilizado herramientas de inteligencia artificial generativa como ChatGPT o Bard en su trabajo.

Pero, ¿la adopción de la tecnología plantea alguna cuestión moral? Después de todo, este es un negocio donde la ética profesional y la confianza pública son especialmente importantes, hasta el punto de que existen campos de estudio dedicados a ello.

En los últimos años, mis colegas y yo en el Centro de Ética Aplicada de la UMass Boston hemos estado investigando la ética de la IA.

Creo que si los periodistas no tienen cuidado con su implementación, el uso de IA generativa podría socavar la integridad de su trabajo.

¿Cuánto tiempo se ahorra realmente?

Comencemos con una preocupación obvia: las herramientas de inteligencia artificial aún no son confiables.

Usarlos para investigar los antecedentes de una historia a menudo dará como resultado una tontería que suena confiada. Durante una demostración de 2023, el chatbot de Google, Bard, escupió la respuesta incorrecta a una pregunta sobre nuevos descubrimientos del telescopio espacial James Webb.

Es fácil imaginar a un periodista utilizando la tecnología como trasfondo, sólo para terminar con información falsa.

Por lo tanto, los periodistas que utilicen estas herramientas para la investigación deberán verificar los resultados. El tiempo dedicado a hacerlo puede compensar cualquier supuesta ganancia en productividad.

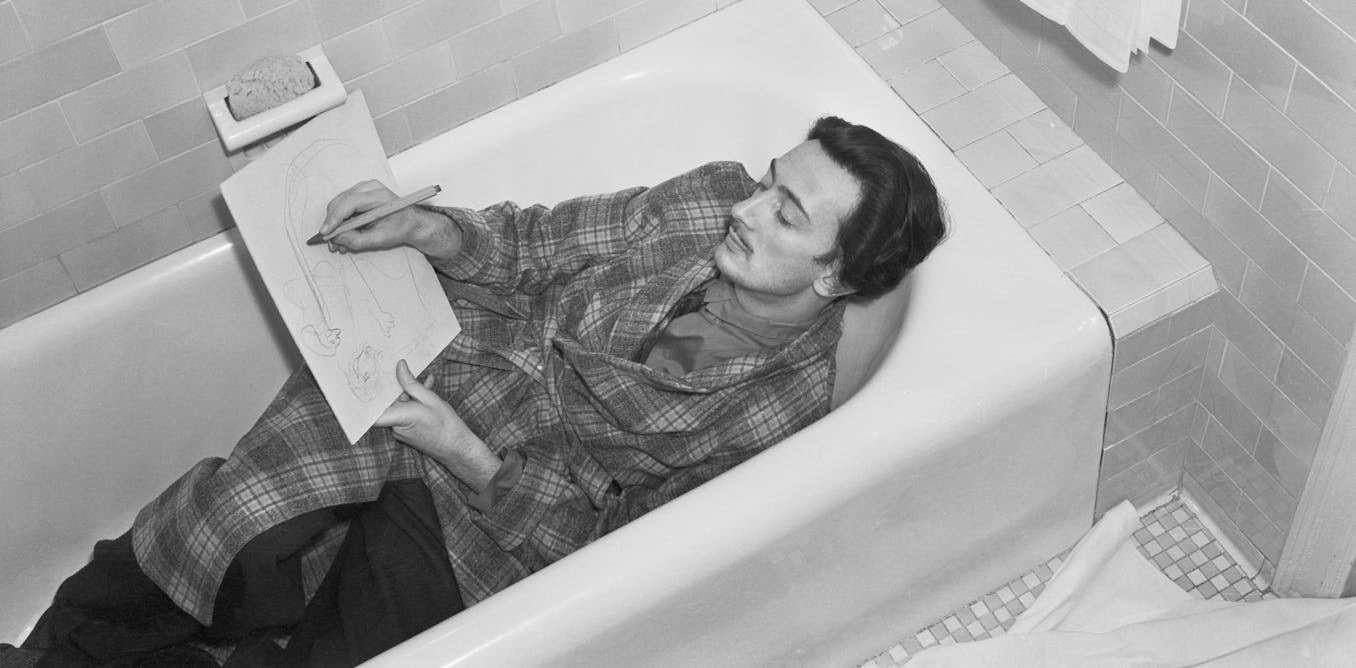

Pero para mí, las preguntas más interesantes tienen que ver con el uso de la tecnología para generar contenido. Un periodista puede tener una buena idea de lo que quiere escribir, por lo que le pedirá a un modelo de IA que produzca un primer borrador.

Esto puede ser eficiente, pero también convierte a los periodistas de escritores en editores, alterando así fundamentalmente la naturaleza de lo que hacen.

Además, hay algo que decir sobre la dificultad para escribir un primer borrador desde cero y descubrir, en el camino, si la idea original que lo inspiró tiene mérito. Eso es lo que estoy haciendo ahora mientras escribo este artículo. Y me entristece informar que descarté algunos de los argumentos originales que quería presentar, porque mientras intentaba articularlos, me di cuenta de que no funcionaban.

En el periodismo, como en el arte, la IA generativa enfatiza –de hecho, fetichiza– el momento en el que se concibe una idea. Se centra en el pensamiento creativo original y relega el tedioso proceso de convertir ese pensamiento en un producto terminado (ya sea mediante delineamiento, escritura o dibujo) a una máquina.

Pero el proceso de escribir una historia es inseparable de las ideas que la originan. Las ideas cambian y toman forma a medida que se escriben. No son entidades preexistentes que flotan pacientemente, perfectamente formadas, esperando simplemente ser traducidas en palabras y oraciones.

La IA socava una relación especial

Para ser justos, solo una parte de los periodistas en ambas encuestas utilizaban IA generativa para redactar borradores de artículos. En cambio, utilizaban estas herramientas para realizar otras tareas, como escribir boletines, traducir texto, crear titulares o redactar publicaciones en las redes sociales.

Una vez que los periodistas vean que la IA tiene bastante talento para escribir (y que está mejorando cada vez más), ¿cuántos de ellos resistirán la tentación?

La cuestión fundamental aquí es si el periodismo implica algo más que simplemente transmitir información al público.

¿Implica el periodismo también una especie de relación entre los escritores y sus lectores?

Creo que sí.

Cuando un lector sigue regularmente el análisis de alguien que escribe sobre Oriente Medio o sobre Silicon Valley, es porque confía en ese escritor, porque le gusta su voz, porque ha llegado a apreciar su proceso de pensamiento.

Ahora bien, si el periodismo implica ese tipo de relación, ¿la socava el uso de la IA? ¿Querría leer periodismo creado por lo que equivale a una agregación anónima de Internet más de lo que querría leer una novela creada por una IA o escuchar música compuesta por una?

O, dicho de otra manera, si leo un artículo periodístico o una novela o escucho una pieza musical, que pensé que fue creada por un ser humano, solo para descubrir que fue generada en gran parte por una IA, ¿no sería mi agradecimiento? o confianza del cambio de pieza?

Si la práctica del periodismo se basa en tener este tipo de relación con el público, el mayor uso de la IA bien puede socavar la integridad de la práctica, particularmente en un momento en que la industria ya está lidiando con problemas de confianza.

Ser periodista es una vocación noble que, en el mejor de los casos, ayuda a sostener las instituciones democráticas. Supongo que esta nobleza todavía importa a los periodistas. Pero la mayoría de los lectores probablemente no confiarían en la IA para defender el papel social que desempeña el periodismo.

A AI no le importa que “la democracia muera en la oscuridad”; no le importa decirle la verdad al poder.

Sí, esos son clichés. Pero también son preceptos ampliamente difundidos que sustentan el comercio. Los periodistas los descuidan bajo su propio riesgo.